Architecture cloud-native : définition et principes fondamentaux

Qu'est-ce que l'architecture cloud-native ?

Le terme « cloud-native » est défini par la Cloud Native Computing Foundation (CNCF) comme une approche qui permet aux organisations de construire et d'exécuter des applications conçues pour exploiter pleinement le cloud, en s'appuyant sur des architectures conteneurisées, orchestrées et découplées. Ce qui la distingue radicalement d'une migration classique, c'est qu'une application cloud-native n'est pas simplement déplacée vers le cloud : elle est conçue pour lui.

La différence entre cloud-enabled et cloud-native est souvent résumée par l'expression lift & shift vs rearchitect. Migrer un monolithe vers Azure sans le transformer, c'est comme apporter une vieille voiture à moteur diesel dans un garage équipé pour les véhicules électriques : l'environnement a changé, mais les contraintes restent les mêmes.

Une application cloud-native est construite comme un système distribué résilient, composé de petits services indépendants qui communiquent entre eux, s'adaptent automatiquement à la charge et reprennent d'eux-mêmes après une défaillance.

Les 5 piliers de l'architecture cloud-native

Ces cinq piliers sont interdépendants. Les retirer l'un de l'autre, c'est fragiliser l'ensemble.

- Microservices : l'application est décomposée en services indépendants et spécialisés, chacun responsable d'une fonctionnalité précise. Une équipe peut faire évoluer le service de paiement sans toucher au catalogue.

- Conteneurisation : chaque service est packagé dans un conteneur (Docker étant le standard), garantissant une portabilité totale entre les environnements de développement, de test et de production.

- Orchestration : des outils comme Kubernetes gèrent automatiquement le déploiement, la montée en charge et la récupération des conteneurs. Azure Kubernetes Service (AKS) en est l'implémentation managée sur Azure.

- DevOps et CI/CD : l'intégration et le déploiement continus automatisent la chaîne de livraison, de l'écriture du code à la mise en production. C'est ce qui rend possible des déploiements fréquents et fiables.

- Résilience et observabilité : l'architecture est conçue pour anticiper les défaillances (design for failure), avec un monitoring, des logs et un tracing distribué qui permettent de détecter et corriger rapidement les anomalies.

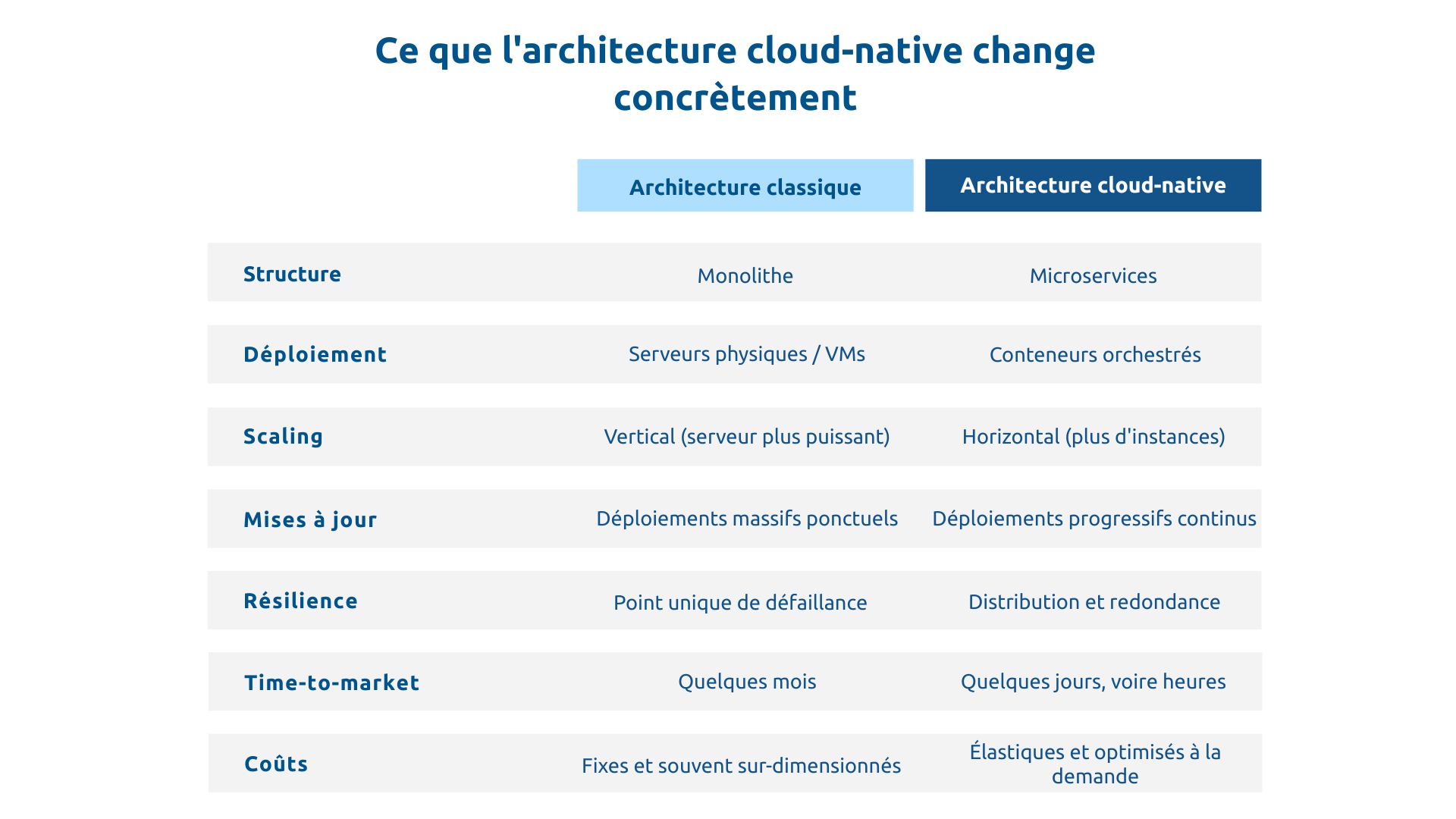

Cloud-native vs architecture traditionnelle

Le cloud-native inverse les compromis habituels : là où l'architecture traditionnelle vous force à choisir entre agilité et stabilité, entre performance et coût maîtrisé, le cloud-native cherche à obtenir les deux simultanément.

Les bénéfices business concrets de l'architecture cloud-native

Agilité et time-to-market accéléré

Dans une architecture monolithique, déployer une nouvelle fonctionnalité implique de redéployer toute l'application, avec les cycles de tests, de validation et de coordination qui vont avec. En architecture cloud-native, chaque microservice se déploie indépendamment. L'équipe en charge du module de commandes peut livrer sans attendre que l'équipe catalogue ait terminé ses développements.

Couplé à un pipeline CI/CD automatisé, ce modèle peut réduire significativement les cycles de release, certaines organisations passant de plusieurs semaines à quelques heures. L'IT cesse alors d'être un frein à l'innovation pour devenir un véritable accélérateur, en lien direct avec les méthodes agiles qui structurent la transformation IT.

Scalabilité élastique et optimisation des coûts

Prenez un site e-commerce dimensionné pour absorber les pics des soldes. En architecture traditionnelle, vous provisionnez l'infrastructure au niveau du pic maximal et vous payez ce sur-dimensionnement toute l'année, même pendant les périodes creuses. Le cloud-native inverse cette logique : l'auto-scaling horizontal adapte automatiquement le nombre d'instances selon la charge réelle, à la granularité du microservice.

Concrètement, cela signifie que vous ne scalez que le service de paiement pendant une période de fort trafic, sans toucher au reste de l'application. Les coûts d'infrastructure tendent vers un modèle plus variable et aligné sur l'usage, sous réserve d'une gestion FinOps adaptée.

Résilience et disponibilité accrues

Imaginez une application cloud-native pour un service de livraison : le module de suivi des colis tombe en panne. En architecture cloud-native, le reste de l'application (consultation du catalogue, passage de commande, gestion du compte) continue de fonctionner normalement. En monolithe, la panne d'un composant peut paralyser l'ensemble.

C'est ce qu'on appelle l'isolation des défaillances. Kubernetes ajoute une couche de protection supplémentaire en redémarrant automatiquement les conteneurs défaillants, sans intervention humaine. Les déploiements peuvent également se faire en zero-downtime grâce aux stratégies blue/green ou canary, qui permettent de basculer progressivement le trafic vers la nouvelle version.

Cette résilience architecturale a un impact direct sur vos SLA et sur la confiance de vos utilisateurs.

Innovation et expérimentation facilitées

L'un des bénéfices les moins visibles, mais les plus stratégiques, du cloud-native, c'est qu'il réduit le coût de l'échec. Quand tester une nouvelle fonctionnalité ne nécessite pas de déployer toute l'application, quand un rollback se fait en quelques secondes et quand un feature flag permet de n'exposer la nouveauté qu'à une fraction des utilisateurs (par exemple 5 %), les équipes osent expérimenter davantage.

Cette culture du test & learn facilite également l'intégration des nouvelles technologies telles que l’IA générative, l’IoT ou traitement temps réel, qui peuvent être connectées comme des microservices supplémentaires, sans remettre en cause l'ensemble du SI.

L'écosystème Azure pour l'architecture cloud-native

Azure Kubernetes Service (AKS) : l'orchestration cloud-native

Kubernetes est devenu le standard de facto pour l'orchestration de conteneurs. Son seul inconvénient : sa complexité opérationnelle, qui peut représenter un frein réel pour des équipes qui ne souhaitent pas y consacrer une expertise dédiée à plein temps.

Azure Kubernetes Service (AKS) résout ce problème en proposant Kubernetes en version managée : Microsoft prend en charge le plan de contrôle, sa haute disponibilité et une partie des mises à jour de sécurité, tandis que la gestion des nœuds et des workloads reste sous la responsabilité du client.

AKS intègre nativement l'auto-scaling, le self-healing et le load balancing et s'articule directement avec le reste de l'écosystème Azure : Microsoft Entra ID pour la gestion des identités et des accès, Azure Monitor pour l'observabilité, Azure Container Registry pour stocker les images Docker. C'est la plateforme de référence pour les architectures microservices complexes sur Azure.

Azure App Services et Azure Functions : cloud-native serverless

Toutes les applications n'ont pas besoin de la puissance ni de la complexité d'AKS. Pour des APIs, des applications web ou des traitements événementiels, Azure App Services et Azure Functions offrent une alternative cloud-native sans orchestration de conteneurs.

Azure App Services est un PaaS qui prend en charge le scaling automatique et la haute disponibilité sans que vous ayez à gérer l'infrastructure sous-jacente. Azure Functions pousse encore plus loin la logique serverless : vous bénéficiez d'une facturation à l'exécution dans le plan Consumption, ou d'un modèle différent selon le plan choisi, ce qui est particulièrement adapté aux traitements ponctuels ou déclenchés par des événements.

Azure Service Fabric et les autres briques cloud-native

Azure Container Apps comble l'espace entre App Services et AKS : il offre la flexibilité de Kubernetes sans sa complexité de configuration, idéal pour des architectures microservices de taille intermédiaire. Azure Service Fabric s'adresse plutôt aux applications microservices stateful les plus complexes, nécessitant une gestion fine de l'état distribué.

Autour de ces plateformes d'exécution, Azure propose un ensemble de services complémentaires indispensables : Azure API Management pour exposer et gouverner vos APIs, Azure Service Bus et Event Grid pour la communication asynchrone entre microservices, Azure Cosmos DB pour les besoins de base de données distribuée à grande échelle nécessitant une forte scalabilité. Ensemble, ces briques forment un écosystème cohérent, à condition de bien les orchestrer, ce qui est précisément l'objet d'une architecture data solide.

DevOps et CI/CD sur Azure : automatisation de bout en bout

Le cloud-native n'est viable que si la chaîne de déploiement est entièrement automatisée. Azure DevOps couvre l'ensemble du pipeline : planification, gestion du code source, intégration continue, tests automatisés, déploiement. GitHub Actions, désormais fortement intégré à l'écosystème Microsoft, constitue une alternative moderne et très utilisée pour les équipes déjà sur GitHub.

L'Infrastructure as Code (IaC), via Terraform ou Bicep (langage recommandé par Microsoft), ainsi que les ARM templates historiquement utilisés, garantit que votre infrastructure est versionnée, reproductible et auditée comme n'importe quel code applicatif. Les stratégies de déploiement progressif (blue/green, canary, rolling updates) permettent de mettre à jour sans interruption de service et de revenir en arrière automatiquement en cas d'anomalie détectée par Azure Monitor ou Application Insights.

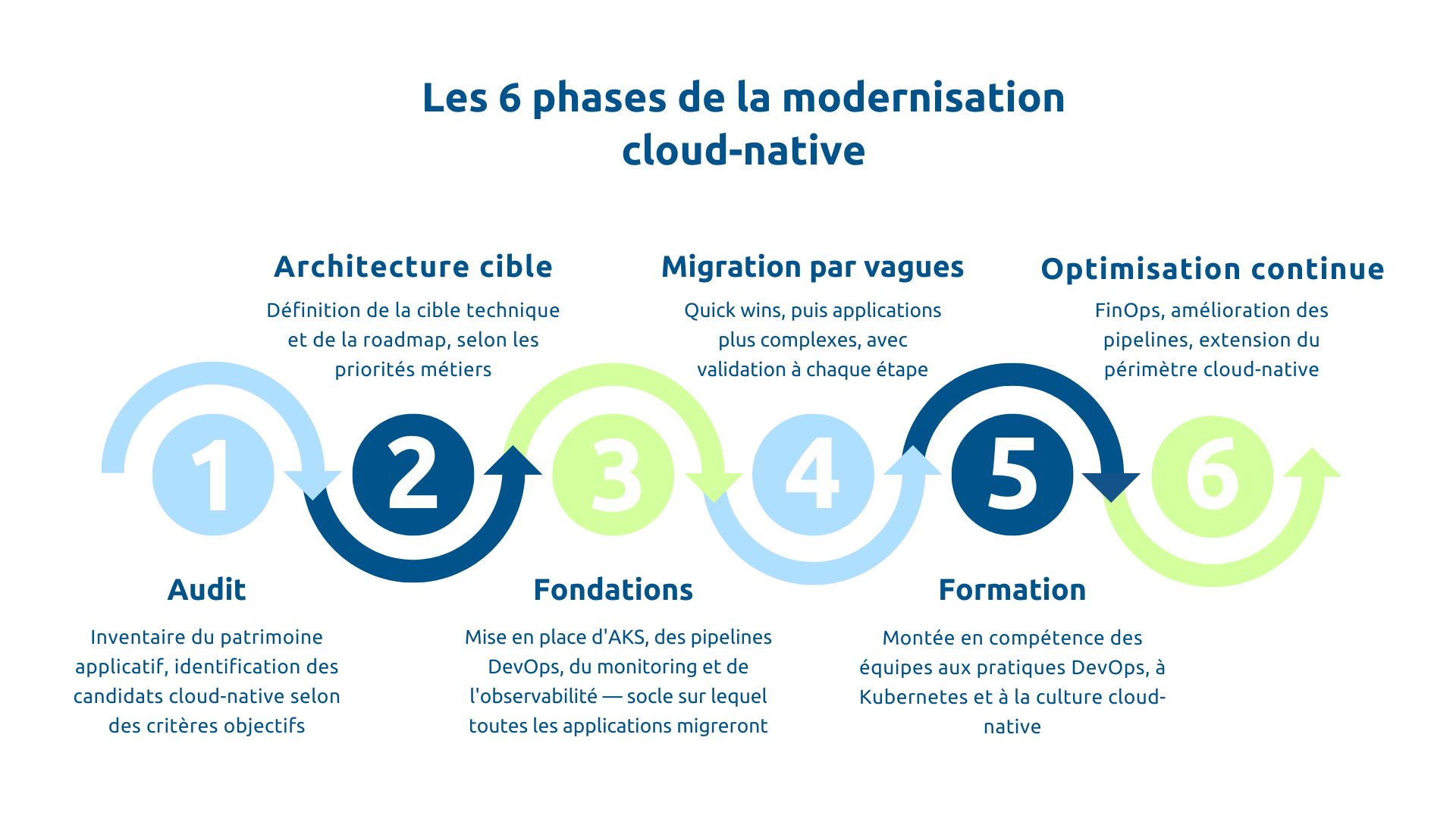

Stratégie de transition vers le cloud-native

Toutes les applications ne doivent pas être cloud-native

C'est peut-être le point le plus important de cet article : la transformation cloud-native ne concerne pas l'intégralité de votre portefeuille applicatif. Certaines applications legacy stables, à faible fréquence de changement et dont la fin de vie est planifiée, n'ont aucun intérêt à être refondues en microservices.

Les bons candidats partagent des caractéristiques communes : forte évolution métier attendue, pics de charge variables, nouvelles applications sans dette technique. La sagesse est de prioriser selon une matrice valeur business / complexité technique, et non de tout refaire par principe.

Les patterns de migration vers le cloud-native

Plusieurs stratégies de transition coexistent, et le choix dépend de votre contexte :

- Greenfield : les nouvelles applications sont développées cloud-native dès leur conception. C'est le cas le plus simple.

- Strangler Pattern : le monolithe est progressivement vidé de sa substance en en extrayant des microservices un à un. Le monolithe et les nouveaux services coexistent pendant la transition.

- Replatforming : conteneuriser l'application sans la réécrire est une première étape pragmatique qui permet de bénéficier de l'orchestration Kubernetes sans refonte profonde.

- Big bang rewrite : à éviter. C'est l'anti-pattern classique qui concentre tous les risques sur un seul déploiement massif.

L'approche recommandée est toujours progressive et itérative, avec des quick wins identifiés dès le départ pour démontrer la valeur et maintenir l'adhésion des équipes.

L'architecture cloud-native n'est pas un buzzword de plus dans le vocabulaire IT. C'est une réponse architecturale aux impératifs modernes d'agilité, de scalabilité et de résilience si on l’aborde avec pragmatisme.

Avec AKS, App Services, Azure Functions et Azure DevOps, Microsoft offre une palette complète de services pour construire et opérer des applications cloud-native performantes. Mais la technologie seule ne suffit pas : il faut une stratégie claire, une approche progressive et une montée en compétence des équipes. Toutes les applications ne doivent pas être transformées, la valeur se crée en choisissant les bons candidats et en avançant par itérations maîtrisées.

Prêt à moderniser vos applications ? Demandez votre audit à nos experts Askware pour identifier vos candidats cloud-native et construire votre feuille de route.